Deep Learning的起源︰第一章-Neural Network

keyword:深度學習deep learning,類神經網路Neural Network。

Neural Network直譯的話就是神經網路,較多數人說的是 :類神經網路

類神經網路是科學家們藉由觀察人類神經並將其數學化的成果,

如上圖我們可以看到是人類的神經網路,

寫成數學式如下:

$a={b+{w}_{1}}{{x}_{1}}+{{w}_{2}}{{x}_{2}}+\cdots

+{{w}_{n}}{{x}_{n}}=b+\sum\limits_{i=1}^{n}{{{w}_{i}}{{x}_{i}}}$

$y=f\left( a \right)$

x是輸入(input):模仿細胞間傳遞時的訊號,可以是很多個。

w是權重(weight):模仿細胞的樹突,對應著每個輸入(input),輸入有幾個權重就有幾個。

b是偏權值(bias):有點閥值的意義,後面會做解釋。

a是還未經過激勵函數的輸出。

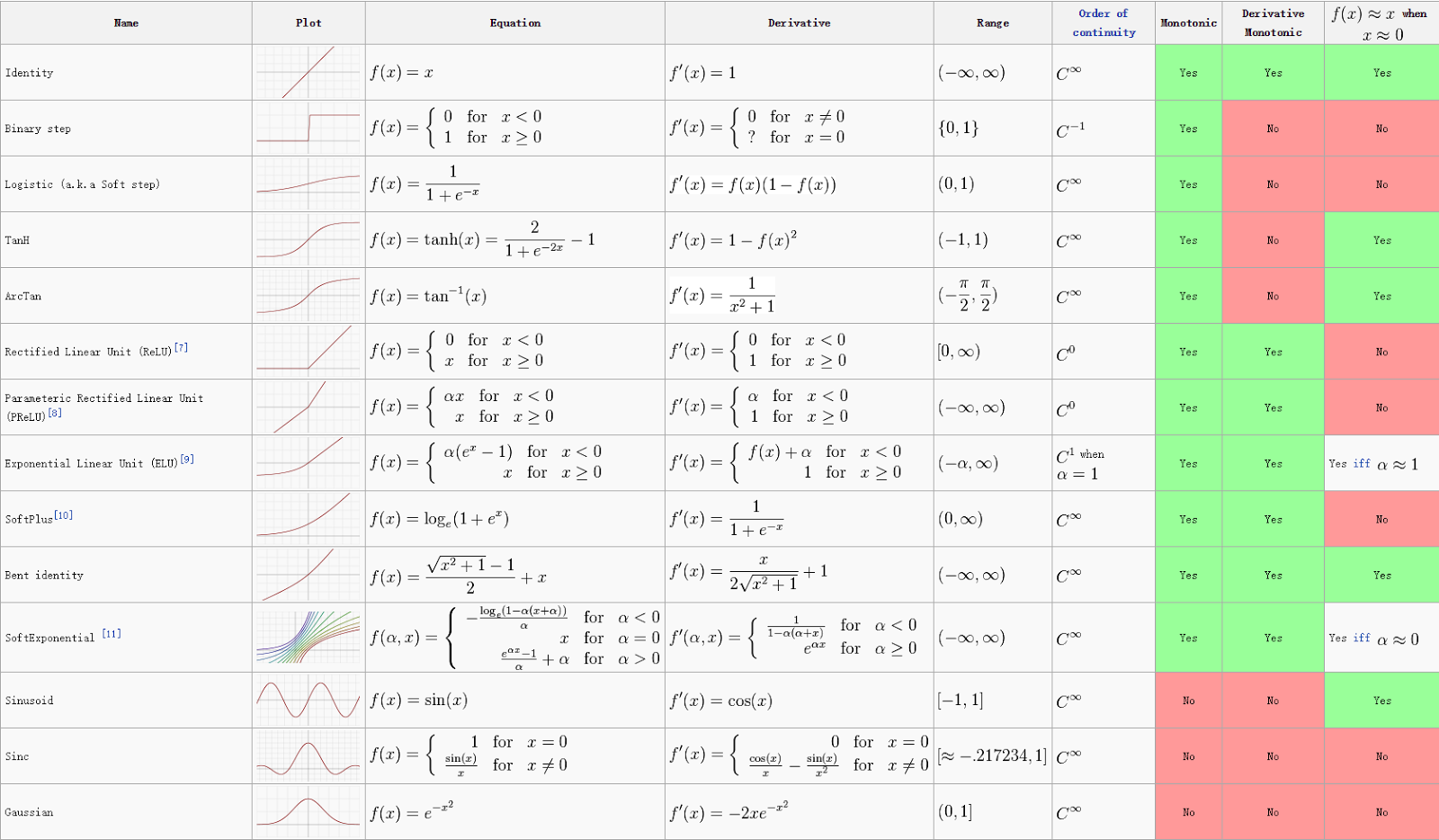

f是激勵函數(activation function)也可稱為轉移函數(transfer function):詳細的激勵函數會另外開一章做講解。

y是輸出(output)。

我們可以將神經傳導的過程解讀為:

輸入訊號(x)

->權重(w)看輸入的訊號哪個重要

->偏權值(b)給予門檻

->激勵函數(f)分辨是否超過門檻

->輸出訊號(output)

舉兩個例子就能理解了

假設有一個神經元

$\left[ {{w}_{1}},{{w}_{2}},{{w}_{3}}

\right]=\left[ 0,1,1 \right]$

$b=-3$

$f\left( a \right)$ 設定為︰

$y=1,a\ge 0$

$y=0,a<0$

我們先了解權重(weight)的意義

假設神經元輸入(input)為兩組不同的訊號

第一組$\left[

x_{1}^{1},x_{2}^{1},x_{3}^{1} \right]=\left[ 0,2,2 \right]$

第二組$\left[

x_{1}^{2},x_{2}^{2},x_{3}^{2} \right]=\left[ 1,0,1 \right]$

接著我們計算結果︰

第一組:

第一組:

\[a={{w}_{1}}x_{1}^{1}+{{w}_{2}}x_{2}^{1}+{{w}_{2}}x_{3}^{1}+b=0\times

0+1\times 2+1\times 2-3=1\]

$y=f(a)=f(1)=1$

第二組:

\[a={{w}_{1}}x_{1}^{2}+{{w}_{2}}x_{2}^{2}+{{w}_{2}}x_{3}^{2}+b=0\times

1+1\times 0+1\times 1-3=-2\]

$y=f(a)=f(-2)=0$

我們可以從上面兩個個結果觀察到 第一組 和 第二組 的結果天差地遠

這個輸出(output)就意味著 - 神經元有沒有被激活,y=1是有,y=0是沒有

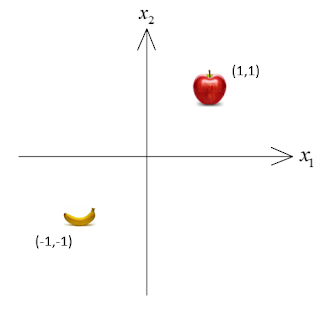

也可以把這個結果解釋為 - 分了兩類,一類為y=1,另一類為y=0

從這邊我們就可以了解到weight的意義為 - 選擇input哪個重要

也可以把這個結果解釋為 - 分了兩類,一類為y=1,另一類為y=0

從這邊我們就可以了解到weight的意義為 - 選擇input哪個重要

接著我們來了解偏權值(bias)的意義

假設神經元input為兩組不同的訊號

第一組$\left[ x_{1}^{1},x_{2}^{1},x_{3}^{1} \right]=\left[ 0,2,2 \right]$

第二組$\left[ x_{1}^{1},x_{2}^{1},x_{3}^{1} \right]=\left[ 0,1,1 \right]$

接著我們計算結果︰

第一組:

第一組:

\[a=0\times 0+1\times 2+1\times 2-3=1\]

$y=f(1)=1$

第二組:

\[a=0\times 0+1\times 1+1\times 1-3=-1\]

$y=f(-1)=0$

我們可以從上面觀察到 第二組 的輸入不過只是 第一組 的縮小

但發生什麼是了呢? 第二組的y=0

這意味著即使input很像我們需要的,但藉由bias我們可以去決定input的強度

~~總整理~~

- 類神經網路是由多個輸入(input)對應多個權重(weight),加上一個偏權值(bias),在藉由激勵函數(activation function)後輸出(output)。

- weight控制input的重要性。

- bias給予閥值的功能限制input的強度。

- 藉由類神經我們能夠簡單的分類問題。

- #請注意#輸入n個和k組是不同的喔,n個輸入表示這個神經元有n個$x$,而k組中的每一組都有n個$x$。

基本的類神經網路就先介紹到這邊

歡迎有問題的人提問,即一起討論喔~~~

歡迎有問題的人提問,即一起討論喔~~~

下一次我們將會介紹:Neural Network的空間意義

謝謝大家~~

Dear 鵬丞

回覆刪除碩士生了,錯字請更正!

w是權重(weight):模仿細胞的樹突,對"硬"著每個輸入(input),輸入有幾個權重就有幾個。

對"應"。

好喔XDD

刪除Betway Virtual Sports Review | Betway App | £20 | UK & NI 제왕카지노 제왕카지노 starvegad starvegad gioco digitale gioco digitale 984Betway Vip & Promo Code | 100% Bonus up to £100 + 100

回覆刪除